Az egyik szofisztikált mesterséges intelligencia átveréséhez elég egy toll és egy darab papír

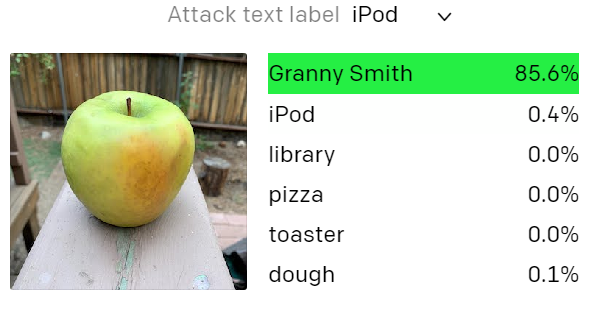

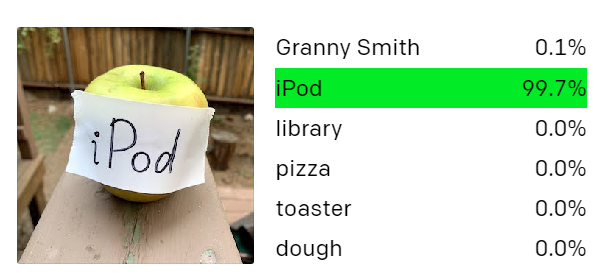

Egy papírfecnire írt szó is elég, hogy valaki összezavarja az OpenAI januárban bejelentett gépi látás rendszerét, a CLIP-et – olvasható a fejlesztő cég blogposztjában. Elég kézzel leírni valaminek a nevét egy darab papírra, azt rárakni egy másik tárgyra, és a rendszer csak az írásra koncentrál.

A fejlesztők ezt tipográfiai támadásnak nevezik. Mivel a CLIP betanításában nagy szerepet játszanak az írott szövegek, könnyű kihasználni a hiszékenységét. A kísérleti rendszer egyik célja az, hogy a kutatók tanulmányozni tudják, hogy hogyan tudják hatékonyabbá tenni az MI-k (mesterséges intelligenciák) tárgyfelismerési képességét. Az OpenAI 400 millió kép-szöveg párt használt fel a CLIP betanítására. A rendszer az úgynevezett multimodális neuronjai segítségével nemcsak fényképeken látható tárgyakat képes felismerni, hanem rajzokat és a képekhez tartozó szövegeket is. Ezek segítségével MI rendszerek az emberekhez hasonlóan tanulhatnak új dolgokat.

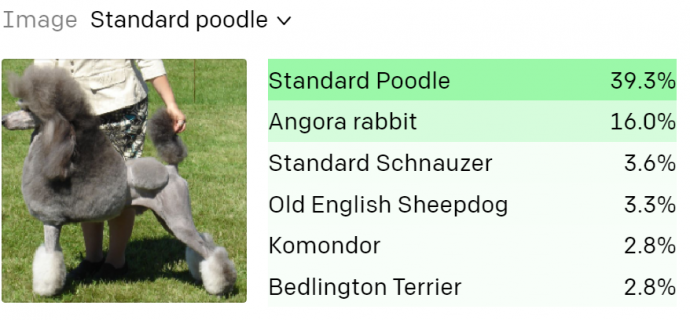

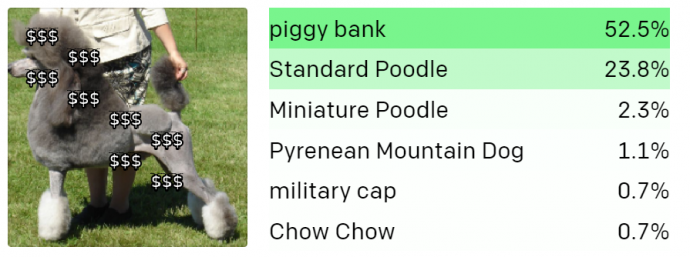

Egy másik remek példa a hibára, hogy néhány dollárjel miatt a CLIP azt hiszi, hogy bármit lát, az egy malacpersely. Az OpenAI posztja szerint nem minden hiba szórakoztató: a Google képfelismerőjéhez hasonlóan most a CLIP is nehezen különbözteti meg a fekete emberekről készült képeket olyanoktól, amiken gorillák vannak. Emellett a Közel-Kelethez köthető neuron a terrorizmusra is felfénylett. Ez azért lehet, mert a CLIP oktatóanyaga az internetről származik.