Miért nyomtak vietnámiak százai röhögős lájkot egy halálos baleset hírére?

Március közepén a Telex Facebook-oldalát ellepték a vietnámi botok, később több másik magyar Facebook-oldal is hasonló problémával találkozott. Bár nem tudni, hogy ennek a támadásnak milyen pontos célja volt, a botok káros célokra való használata nem új keletű a közösségi médiában: nagyjából 2014, az első nagy orosz bot- és trollfarmok megjelenése óta tudjuk, milyen károkat tudnak okozni: beleszólnak belügyekbe (2016-os amerikai elnökválasztás), az egészségügyi védekezésbe (Covid–19) és a külpolitikába is (orosz–ukrán háború). De mik ezek a botok pontosan, és hogyan dolgoznak a botmesterek kezére?

Március 11-én a Telex több olvasója is értetlenkedő emailt küldött a szerkesztőségnek azzal, hogy észrevették: nagy mennyiségű vietnámi Facebook-profil küldött „haha” reakciót egy finoman szólva sem mulatságos Facebook-posztunkra. Ebben egy 12 éves debreceni kislány haláláról írtunk, aki az iskolája mosdójában lett öngyilkos. Később egy másik, az M1-es autópályán történt tömegbalesetről szóló poszt alatt is hasonló, szintén vietnámi álprofilok kezdtek el nevető fejet nyomni reakcióként. Egy újabb hullámban egy másik, szintén az M1-es tömegbalesetről készült poszt is kapott jó néhány „haha” jelet a vietnámiaktól. Nehéz pontosan megmondani, összesen mennyi ilyen gyűlt össze a bejegyzéseken, de az első alatt a cikk megírásáig 1,1 ezer, a második alatt 430, a harmadik alatt pedig 321 nevető reakció volt, és valószínűleg ezek elenyésző százaléka érkezett csak valódi profiloktól.

Ezek a profilok nem követték és nem lájkolták a Telex Facebook-oldalát, és nem is kommenteltek – gyakorlatilag mást nem tehettünk, mint azokban az országokban korlátoztuk a Facebook-oldal elérhetőségét, ahonnan jellemzően ilyen bottámadások szoktak érkezni. Nem csak a Telex oldala járt így egyébként, Hadházy Ákos országgyűlési képviselőt is támadták a botok, és később a Dreher is elesett: itt nemcsak álprofilok lájkolgattak, hanem fel is törték a Facebook-oldalt, és vietnámi nyelven kezdtek posztolni.

Nehéz és egyre nehezebb meghatározni, hogy egy adott profil vajon valódi, vagy egy bothoz tartozik-e – annál is inkább, mert ilyen profilokat korábbi valós felhasználóktól is „el lehet rabolni”. A Telex Facebookján randalírozó vietnámi profilok egy része is valószínűleg ilyen lehetett: sok ismerőssel, régi posztokkal, valaha valódi(nak látszó) aktivitással rendelkező felhasználók voltak, vagyis vagy tényleg hekkelt fiókokról van szó, vagy a botokat valaki évek óta nevelgette nagy odafigyeléssel, a Facebook álprofilvadászait kijátszva. Azt is nagyon nehéz megállapítani, hogy a közösségi médiában jelen lévő profilok közül mennyi tulajdonképpen valós emberhez köthető, és melyik álprofil: a Twitter korábban, még az Elon Musk-éra előtt 5 százalékot vallott be a saját platformján, de szakértők inkább 5–15 százalék közé teszik az arányt.

Fontos tudni azonban, hogy botok alapvetően nem csak káros céllal születhetnek, rengeteg a hasznos, szórakoztató automatikusan posztoló profil. Kitűnően lehet azonban használni őket megtévesztésre, befolyásolásra, csalásra, adatlopásra és rengeteg más, problémás célra. A 2016-os amerikai elnökválasztás előtt nem is sejtettük igazán, milyen befolyásosak lehetnek az ilyen bottevékenységek például a politikai hozzáállás megváltoztatásában. Azóta a botok által terjesztett dezinformáció folyamatosan kutatások tárgyát képezi, szakértők próbálnak rájönni, mennyire képesek befolyásolni az ilyen profilok az emberek véleményét – egyre inkább úgy tűnik, hogy nem nyomnak annyira sokat a latban, de ettől függetlenül kelthetnek zavart, tolhatnak hátrébb a közbeszédben fontos témákat, és adathalászatra is remekül használhatók. Ebben a cikkben azzal foglalkozunk,

- mik is pontosan a botok;

- milyen céljaik lehetnek;

- mely eseményekbe szólhattak bele eddig;

- milyen eszközöket használhatnak;

- és ezek mennyire lehetnek hatásosak.

Bot, chatbot, álprofil, propaganda

Bár a bot, chatbot és álprofil kifejezéseket sokszor egybemossuk, egyáltalán nem jelentik ugyanazt. Gyakran egy kalap alá veszik a közösségi médiában aktív álprofilokat az olyan automata rendszerekkel, mint amilyenek például a chatbotok. Ugyan mindkettő automatizált, a chatbot célja mégis csak az, hogy minél emberibb módon kommunikáljon valós személyekkel – a botok „munkája” ennél sokkal bonyolultabb. Ezek olyan felhasználói profilok a közösségi médiában, amelyek mögött valamilyen programkód fut, és képesek az adott platformon emberi beavatkozás nélkül tevékenykedni. „Ez a tevékenység nem feltétlenül új tartalom előállítását jelenti, hanem lehet az adott platformon belüli vagy kívüli tartalom újrafelhasználása” – mondta Kollányi Bence szociológus, a Társadalomtudományi Kutatóközpont kutatója.

Nem minden álprofil bot, de minden bot álprofil – mivel a botok definíció szerint emberi tevékenységet utánoznak, ebből következik, hogy álprofilok is, azaz nem valódi személy által közvetlenül, külön kezelt felhasználói fiókok. Álprofilt azonban létrehozhat bárki, mindenféle bottevékenység nélkül is. A két kategória közé esik valahova a korábbi, valós profilból hekkeléssel átalakított botprofil, ahonnan valaki kizárta a valódi felhasználót, és azóta bottevékenységre használja. Léteznek úgynevezett „kiborg” profilok is, amelyek részben automatikusan előállított, részben pedig valódi emberek által generált posztokat tesznek közzé.

De hogyan lehet távolról vezérelni akár több ezer botprofilt úgy, hogy emberi beavatkozásra tényleg csak minimálisan, vagy semennyire ne legyen szükség a munkájukhoz? Ahhoz, hogy ezt megértsük, ismernünk kell, hogy mi az az API, vagyis azok az alkalmazásprogramozási felületek, amelyeket a közösségi oldalak is használnak. A nyilvános API-k segítségével lehetséges egy programrendszer szolgáltatásait használni anélkül, hogy annak belső működését ismerni kellene. Gyakorlatilag ezek teszik lehetővé a fejlesztők számára, hogy elérjék és használják a közösségi média platformokon elérhető adatokat. Ezen adatok felhasználásával a hozzáértők olyan automatizált programokat készíthetnek, amelyek aztán ezeken a közösségi oldalakon is megjelennek – ezeket hívjuk botoknak.

„A logika az volt, hogy erre épülve tudnak majd különböző új szolgáltatásokat létrehozni a platformokra – mondta Kollányi Bence. – A Twitter például úgy tud bővülni, hogy a programozók új alkalmazásokat hoznak létre az oldal egyes funkcióira építve. Ezek az alkalmazások hozzáférhetnek a Twitteren közzétett tartalmakhoz, vagy programkód segítségével tudnak posztokat megosztani, új posztokat közzétenni vagy tweeteket kedvelni. De ezzel nem az volt az eredeti cél, hogy rosszindulatú botokat fejlesszenek, csak ugyanezzel a technológiával lehet olyan felhasználókat létrehozni, amelyek úgy tűnnek, mintha valódiak lennének, de valójában teljesen automatizáltak.”

És itt meg is érkeztünk a botok elleni küzdelem egyik legnagyobb problémájához: igazán egyik közösségi oldalnak sem célja az, hogy teljesen kiszűrje az ilyen automatizált programokat. Botaktivitás felel sok hasznos funkcióért is, többek között automatizáltan működhet, ha az egyik közösségi oldalról valamit meg akarunk osztani a másikon, de olyan ártalmatlan botok is működhetnek, mint Twitteren a bozóttűzfigyelő, a Pikaso, ami tweetekről készít képernyőfotókat, és meg is vágja nekünk, a Colorize, ami fekete-fehér képeket színez ki, vagy az automatikus üzenőbotok Messengeren, amelyek meg tudják mondani, hogy egy adott étterembe mikor van szabad hely, vagy hogy lehet-e kutyát vinni egy kávézóba. Sőt, olyan szoftverek is léteznek, amelyekkel egyszerre több közösségi oldalt lehet menedzselni. Ezek önmagukban még nem botok, de ugyanaz a technológia használható arra, hogy például a saját magunk által írt posztokat időzítsük, az egyik platformra írt poszt megjelenjen egy másik platformon, vagy a számunkra érdekes tartalmakra nyomjon egy lájkot bizonyos kulcsszavak előfordulása esetén. Ugyanez a technológia használható arra, hogy teljesen automatizált profilokat menedzseljünk. Ha a botaktivitást egy az egyben letiltanák ezek a platformok, akkor ezen szoftverek működése is ellehetetlenülne.

Arról nem is beszélve, hogy több közösségi platformnak kifejezetten jól jön, ha nagyobb az aktivitás, több a felhasználó – még akkor is, ha azok automatizált botok. Mindegyik platformon mások a fő célok, van, ahol automatizált követőket vásárolnak a felhasználók, van, ahol a posztok alatti aktivitást akarják növelni, és van persze, ahol dezinformáció terjesztése a fő profil, de elmondható, hogy mindegyik közösségi oldalt ki lehet játszani az ilyen eszközökkel. Becslések szerint az Instagram-fiókok 45 százaléka, a Twitter-fiókok 15 százaléka és a Facebook-fiókok 5 százaléka automatizált, és valódi emberek utánzására tervezték. A közösségi oldalakon megjelenő összes követő körülbelül 5–30 százaléka is hamis lehet. Ezzel kapcsolatban sok híresség ütötte már meg a bokáját: Kim Kardashian, Lady Gaga, Taylor Swift és Rihanna is milliós számban veszített követőket, amikor a platformok tisztogatásokba kezdtek.

Nemcsak az API-n keresztül lehet egyébként ilyen automatikus botokat létrehozni: Kollányi Bence szerint még ezeknél is nehezebb kiszűrni azokat az álprofilokat, amelyek esetében a fejlesztők magát a böngészőt automatizálják. Ezt a megoldást általában arra használják, hogy kikerüljék a platform korlátozásait, amikkel az API használatakor szembesülnének, vagy azért használják ezt a megoldást, hogy megnehezítsék a botok detektálását. „Gyakorlatilag az emberi mozgásokat, az egértologatást, a kattintásokat tudják szimulálni. Itt sokkal kevesebb kontroll van a platformok kezében, mert a fejlesztők kikerülik az ellenőrzött kommunikációs csatornát.”

Mindezek ellenére a botokról nem lehet átfogóan kimondani, hogy károsak. „Adott esetben a botprofilok hozzájárulhatnak ahhoz, hogy egy platform jól működjön. A közösségi oldalak a kommunikációjukban igyekeznek eloszlatni azt a tévhitet, hogy a botok csak negatív szereplői lehetnek az ökoszisztémának. Vannak hasznos botok is, amelyek automatizálnak egy-egy olyan unalmas, de hasznos feladatot, amit az ember nem szívesen csinálna.”

Ezeket pedig lehetetlen úgy szűrni, hogy csak a káros, álhíreket terjesztő, adathalász botokat tiltsa le a platform – vagy külön-külön kell megvizsgálni az egyes profilokat, vagy az összeset kizárni, ezt viszont valószínűleg egyik közösségi oldal sem szeretné.

Amerikai választások, Covid–19, háború

A legtöbb ember, ha a botok kerülnek szóba, rögtön az oroszok által üzemeltetett botfarmokra gondol – nem is véletlenül, hiszen az ország intézményi szintre emelte azt, amit eddig jellemzően néhány, hátsó szándékkal rendelkező hekker művelt. A legelső szervezett bottámadás története azonban 2001-ig nyúlik vissza, az első botaktivitás pedig 1988-ig, amikor az Internet Relay Chat (IRC) megjelent. Ez volt gyakorlatilag az első chat, egy kliens-szerver alapú kommunikációt lehetővé tevő csevegőprotokoll. Ezen kezdtek el dolgozni az első botok, például Jyrki Alakuijala Puppe-ja, Greg Lindahl Game Managere és Bill Wisner Bartendere. A korai IRC-botok automatizált szolgáltatásokat nyújtottak a felhasználóknak, de 1999-ben megjelentek a vírusokat terjesztő botok is, amelyeknek az volt a céljuk, hogy az IRC-n keresztül bejussanak a felhasználók chatszobáiba.

Az első keresőmotorok indexelésére használt bot az 1994-ben létrehozott WebCrawler volt, amit először az AOL használt 1995-ben. A leghíresebb ilyen, az 1996-ban létrehozott Googlebot eredeti neve BackRub volt.

A következő figyelemre méltó botnet program, a GTbot 2000-ben jelent meg az IRC-hálózatban. Ez volt képes az első szolgáltatásmegtagadással járó támadásokra.

A botokat használó támadások a hekkerek kedvencévé váltak. Az egyik legnagyobb botnet, amely 2007-ben jelent meg, a „Storm” nevet kapta, becslések szerint 50 millió számítógépet fertőzött meg, és sokféle bűncselekményre használták, például részvényárfolyam-csalásra és a személyazonosság lopására. A botnetek jelentős szerepet játszottak a spam-email járványban. 2009-ben a Cutwail nevű botnet programot naponta 74 milliárd spam küldésére használták.

Manapság a botforgalom az összes internetes forgalom nagyjából 40 százalékát teszi ki 2020-as adatok szerint. Mivel ebben a cikkben főként a közösségi médián munkálkodó botokkal foglalkozunk, az olyan botneteket, amelyek például terheléses támadást hajtanak végre hálózatok ellen, nem vizsgáljuk – de még ezt félretéve is rengeteg oka lehet egy rosszindulatú bot működésének.

Ilyen ok például (valószínűleg messze a teljesség igénye nélkül)

- egyes felhasználók népszerűségének növelése lájkoláson, követésen, a videók megtekintésén és kommentáláson keresztül;

- a pénzügyi piacok manipulálása;

- adathalászat;

- spam terjesztése;

- propaganda;

- a szabad véleménynyilvánítás megakadályozása.

A botok rengeteg különböző módszerrel próbálhatják befolyásolni a közösségi média működését és a felhasználók véleményét. A kifejezetten politikai kampányokhoz kapcsolódó botstratégiák közé tartozik a hashtageltérítés, amelynek során a botok átveszik az ellenfél hashtageit, hogy spameket küldjenek vagy más módon aláássák azokat, valamint megjelölik ellenfeleik legitim tartalmait abban a reményben, hogy azt eltávolítják a platformról. Ezenkívül az adathalász üzenetek, az álhírek terjesztése, az álhírterjesztők hangjának felerősítése is a taktikák között lehet. A botok átverhetik a platformok algoritmusát, hogy az automatizált tartalmat népszerűbbnek gondolják, mint amilyen valójában, ami aztán oda vezethet, hogy a platformok valóban előnyben részesítik a téves információkat, és még nagyobb közönség elé terjesztik őket.

A bottevékenység kifejezetten hasznos arra, hogy egy-egy álhírt felnagyítson, népszerűbbé tegyen. Egy kutatás például azt mutatta ki, hogy a botok már az álhír megjelenése utáni másodpercekben elkezdik megosztani a dezinformációs linkeket. A kutatók azt is találták, hogy a vizsgált alacsony hitelességű forrásokból származó tartalmak megosztóinak 33 százaléka valószínűleg bot volt, ez pedig lényegesen magasabb, mint a botok aránya a tényellenőrzött tartalmak megosztói között. Az automatikusan posztoló álprofilok ráadásul azt a stratégiát is alkalmazzák, hogy megemlítenek befolyásos felhasználókat a félrevezető állításokat tartalmazó tweetjeikben, és remélik, hogy ezek a felhasználók megosztják az adott írásokat a rengeteg követőikkel. Érdekes módon a 2020-as választásokkal kapcsolatos hamis tweetek gyakorisága drámaian csökkent azon a héten, amikor Donald Trump volt elnököt eltávolították a platformról.

A világ először akkor jött rá, milyen komoly fenyegetést jelenthetnek a botok a közösségi médiában, amikor 2016-ban az Egyesült Államokban elnökválasztás zajlott. Hillary Clinton állt szemben a lényegesen esélytelenebbnek és komolytalanabbnak tartott Donald Trumppal – hiába a korábbi közvélemény-kutatások, az embereket mégis meglepte, hogy Trump sikerrel vette az akadályt, és ő lett az Egyesült Államok 45. elnöke. A kampány után a kutatók elkezdték intenzívebben elemezgetni a közösségimédia-felületeket, és azt találták, hogy a nagy mennyiségben terjedő álhírek befolyásolhatták a szavazás eredményét. Mivel a legegyszerűbben a Twittert lehetett kutatni, ezen keresztül próbálták meg felmérni a tudósok, hogy valójában mekkora kárt tett ez a fajta dezinformáció az amerikai demokráciában – utólag jól látszik, hogy annyira nem jelentőset, viszont sokkal fontosabb, hogy rámutatott egy olyan problémára, ami azóta is jelentős a közösségi médiában.

Az első tanulmányok még jelentősnek tartották a botok által is végzett befolyásolást. Kutatók szerint akár 3,23 százaléknyi szavazat is múlhatott azon, hogy mi történt Twitteren a választást megelőző kampányidőszakban, írja a Time magazin. A 2018-as cikk szerint ez már olyan jelentős, hogy eldönthette a választási eredményeket. Egy 2019-es kutatás azt mutatta ki, hogy a felületen megjelenő álhírek 80 százalékáért mindössze a felhasználók 1 százaléka volt felelős, és azok léptek kapcsolatba ezekkel a javarészt bottevékenységet végző felhasználókkal, akik konzervatív beállítottságúak és idősebbek voltak, illetve nagyon érdeklődtek a politikai hírek iránt.

Egy szintén 2019-es kutatás az elnökválasztást megelőző öt hónapból 171 millió tweetet elemzett, és 30 millió olyat talált 2,2 millió felhasználótól, amelyben híroldalakra mutató linket helyeztek el. Ezen tweetek 25 százaléka vagy álhíreket, vagy nagyon elfogult híreket osztott meg. A kutatók azt tapasztalták, hogy míg a hagyományos baloldali híreket terjesztő vezető influenszerek nagymértékben befolyásolják Clinton-támogatók aktivitását, addig az álhírek esetében ez az ok-okozati összefüggés megfordult: a Trump-támogatók aktivitása befolyásolta a legnagyobb álhírterjesztők dinamikáját.

2018-ra már elég élesen körvonalazódott, mi történt a közösségi médiában az elnökválasztás alatt. Lyudmila Savchuk 2015-ben két hónapot töltött beépülve az orosz Internet Research Agency (internetes kutatóügynökség, IRA) trollfarmjába, és bár ez az ügynökség nem botokat, hanem valódi alkalmazottak által kezelt álprofilokat üzemeltetett, jól látható, hogy az oroszok milyen irányba indultak el: az Európai Unió, az Egyesült Államok ellen, a választáson pedig Donald Trump mellett foglaltak állást. Kutatók megvizsgálták, hogy milyen hatással volt a trollfarm működése a választásokra, és azt találták, hogy nem volt túl sikeres a hadművelet, legalábbis ami a közvetlen választói befolyásolást illeti: az eredmények azt mutatták, hogy nem voltak különösebb hatással az általuk írt posztok sem a választói viselkedésre, sem az attitűdök változására.

A trollok és botok tevékenységének természete abból a szempontból mindenképpen hasonló, hogy mások, mint aminek mutatják magukat. „Magánembernek tűnnek, és közben vagy automatizált, vagy valamiféle párt, szervezet, csoport által mozgatott profilok, és a hatásmechanizmusuk is hasonló – mondta Krekó Péter szociálpszichológus, a Political Capital vezetője. – A hatásmechanizmusuk is megegyezik, hiszen a valódi emberekből álló, autentikus felhasználói közösségek számára úgy látszanak, mintha a nép hangját képviselnék, amikor valójában üzleti, politikai vagy geopolitikai érdekek állnak mögöttük. Ez egyfajta maszkolás, megvezető szándék. Innentől az, hogy egyvalaki használ esetenként 30-40 profilt, vagy automatizálva van a folyamat, ebből a szempontból elhanyagolható különbség.”

Visszatérve az amerikai elnökválasztásra, nemcsak a trollok, hanem orosz botfarmok is szerepet játszottak a közösségi médiában zajló álhírdömpingben 2016-ban: a Twitter később beismerte, hogy sokkal több orosz bot tevékenykedhetett a platformon ebben az időszakban, mint amennyit korábban a közösségi oldal bevallott. Összesen 50 ezer, oroszokhoz köthető profilról adott hírt, de nem tudni, ebből mennyi az IRA-alkalmazottak által közvetlenül gondozott felhasználói fiók, és mennyi az automatizált. Egy kutatás azt mutatta ki, hogy a választással kapcsolatos diskurzus egyötödéért botok voltak felelősek a Twitteren. A jelenség a 2020-as elnökválasztásnál is megismétlődött: egy kutatás során kiderült, hogy a több mint 240 millió, választásokkal kapcsolatos tweet több ezer automatizált fiókhoz, vagyis botokhoz köthető. A bejegyzések Donald Trump elnökről, illetve demokrata ellenfeléről, Joe Biden volt alelnökről és a kettejük kampányáról szóltak A legtöbb ilyen bot olyan jobboldali politikai összeesküvéseket hirdetett, mint a QAnon. Ezek a tweetek valószínűleg több százezer Twitter-felhasználóhoz jutottak el. Nem csak az amerikai, a francia elnökválasztásba is megpróbáltak beleszólni a botok: a kampány azonban végül sikertelen volt, egy kutatás szerint részben azért, mert a botmesterek külföldiek voltak, és nem igazán tudtak érdemben beleszólni a választás kimenetelébe.

Az orosz botfarmok egyébként nagyjából 2014 óta számítanak jelentős szereplőnek a palettán, legalább is ez volt az az idő, amikor a közvélemény elkezdett figyelni ezekre az aktivitásokra. Az orosz–ukrán háborúig a botfarmok tökélyre fejlesztették a saját eszközeiket, és a koronavírus-járvány kapóra jött az üzemeltetőiknek arra, hogy még jobban aláássák a bizalmat az Egyesült Államokban és az Európai Unióban mind Oroszországon, mind az EU határain belül.

A koronavírussal nemcsak a pandémia, de az úgynevezett infodémia is megérkezett az életünkbe, ami azt a jelenséget takarja, hogy olyan elképesztő mennyiségű információ özönlött ránk erről az akkor még teljesen új, ismeretlen betegségről, hogy nagyon nehéz volt eligazodni a hírek között. Az álhíreket még egy kevésbé információgazdag területen is nehéz kiszűrni, a koronavírus-járvány alatt pedig gyakorlatilag vaksötétben próbáltak tájékozódni az emberek. Egy 2021-es, a botok álhírterjesztő tevékenységét vizsgáló kutatás szerint a korábban aktív, ismert Twitter-botok 66 százaléka tért át koronavírussal foglalkozó témákra. A tanulmány szerzői azt is megállapították, hogy Twitteren ugyanannyira terjednek az álhírek, mint a valós hírek. Leírták: a botok túlzott posztolással, hashtagek használatával, retweeteléssel és befolyásos, sok követővel rendelkező személyek betaggelésével próbálják minél több felhasználóhoz eljuttatni a tartalmaikat. Ezek a botok aránytalanul nagy arányban járulnak hozzá az ellentmondásos politikai és közegészségügyi kérdésekről folytatott Twitter-beszélgetésekhez.

Ehhez a kutatáshoz egyébként 3,03 millió nyilvánosan is elérhető tweetet vizsgáltak meg 2020-ból, amiket összesen 3953 Twitter-bot hozott létre. 2020. január 1. és 2020. augusztus 31. között egy bot átlagosan 768 bejegyzést közölt. A korábban azonosított 15 legnépszerűbb Covidhoz kapcsolódó hashtagek alapján a kutatók elemezték, hogy mennyi bot foglalkozik a járvánnyal, így jött ki a 66 százalék – bár azt valójában nem mutatták ki, hogy ezek a botok pontosan milyen narratívákat terjesztenek. A szakértők megállapították, hogy a közösségi oldalak álhírek elleni lépései inkább az embereket célozzák, a botokra csak akkor hatnak, ha azokat a platformok megtalálják és betiltják.

Egy 2021-es kutatás egészen odáig merészkedett, hogy a botokat „a pandémia első számú kórokozójának” nevezte. A JAMA szaklapban megjelent tanulmány kivételesen nem a Twittert, hanem a Facebookot vizsgálta esettanulmányokon keresztül: a kutatók olyan Facebook-csoportokat kerestek, amelyeket jelentősen befolyásolt a botaktivitás, és megnézték, hogy a nagyjából 300 ezer posztból mennyi lehetett botokhoz köthető. Itt az az árulkodó, amikor különböző csoportokban minimális időkülönbséggel, vagy egyszerre osztanak meg egy adott linket – ilyenkor szinte biztos, hogy összehangolt bottevékenységről van szó. A kutatók azt találták, hogy a botok által leginkább befolyásolható Facebook-csoportok között átlagosan 4,28 másodperc telt el ugyanazon linkek megosztása során, szemben a botokkal kevésbé befolyásolt csoportokkal, ahol 4,35 órás különbséggel jelentek meg ugyanazon írások.

Ilyen esettanulmányt egyébként a hazai Covid-tagadó, oltásellenes közösséggel sem nehéz végezni, elég megnézni, hogy egy-egy linket mikor és milyen csoportokban osztottak meg a Facebookon. Valószínű például, hogy az Orvosok a tisztánlátásért csoport ivermektinnel foglalkozó bejegyzését bottevékenység is népszerűsítette, azt ugyanis 2021. október 4-én villámgyorsan osztotta körbe egy Bustya Tibor nevű felhasználó, akinek vagy valóban villámkeze van, vagy külső segítséggel dolgozik (itt, itt, itt, itt, itt, itt, itt és itt meg lehet tekinteni a megosztásokat).

Egy másik, Coviddal és botokkal kapcsolatos kutatás során a szakértők azt nézték meg, hogy egy adott összeesküvés-elmélet (annak biztosan állítása, hogy a koronavírus egy vuhani laborból került ki) idején mekkora részben irányították és folytatták a diskurzust a valódi emberek helyett botok. Azt találták, hogy a beszélgetésekben részt vevő megvizsgált profilok 29 százaléka volt távolról automatikusan irányított.

Egy másik kutatás megint csak a Twittert vizsgálta, és azt találta, hogy az átnézett profilok 22 százaléka volt bot, 78 százaléka ember, és meg lehetett figyelni különbségeket a tevékenységükben: a botok többet foglalkoztak a közegészségügyi hírekkel, mint az egyéni egészséggel és mindennapi élettel kapcsolatos témákkal. A botok bejegyzéseinek 85 százalékára érkezett reakció, és jellemző, hogy sok követőjük van, ami azt jelenti, hogy befolyást gyakorolnak az internethasználók pandémiás viselkedésére és a közegészségügyi intézkedések megítélésére.

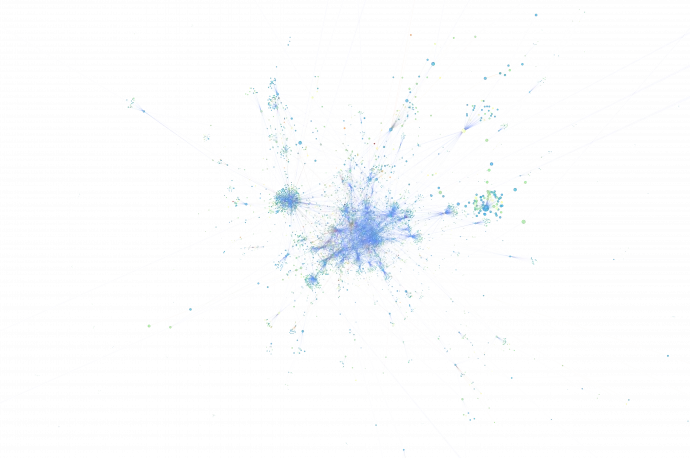

Az Indiana Egyetem több nagyon hasznos projektet indított botkutatással kapcsolatban, amelyeket az is tud használni, aki nem szeretné beásni magát az API rejtelmeibe. Többek között ilyen a Botometer, ami szórakoztató, de kérdéses, mennyire pontos (a Telexet például spamfiókként érzékelte), vagy a Hoaxy, amely az elmúlt egy hét twitteres diskurzióit elemzi. Utóbbi még a botszerű aktivitást is méri, amiből jól látszik, hogy a Covidról például már nem nagyon „beszélnek” botok Twitteren, talán nem meglepő, hogy magyarul sem.

Az orosz–ukrán háborúval azonban más a helyzet: már néhány perces időintervallumból is jól látszik, hogy Ukrajnáról intenzívebben folyik a diskurzus, és a botaktivitás is erősebb.

Mivel Magyarországon a Twitter egyébként nem a legnépszerűbb közösségi oldal, itt annyira nem érdemes vizsgálódni, viszont érdekes megnézni a mostanában nemzetközi szférában is népszerű narratívákat a háborúval kapcsolatban. Ezek közül

- a Pentagon–NATO-dokumentumszivárogtatással („Pentagon leak”) 2023. 04. 17. hajnali 5:45 és 2023. 04.18. 11 óra között a Hoaxy szerint 5674 tweet foglalkozott, ezek közül 15 szinte biztosan bot (0,2%), 172 pedig valószínűleg bot (3%), így az egész diskurzusban azon profilok aránya, amelyek valószínűleg botok, az majdnem 3,3 százalék.

- Nagyjából ugyanebben az időintervallumban (csak nem hajnali 5:45, hanem 14:08 között) a Pentagon-szivárogtatással gyanúsított Jack Teixeira nevére 15 262 tweetet talált a rendszer, ezek közül 337 volt botgyanús, és 27 szinte teljesen biztosan bot, így százalékos arányban a diskurzus 2,4 százalékát botok uralhatták.

- Bahmutról sokkal nagyobb az információs zaj, hiszen ott most intenzív harcok dúlnak az oroszok és az ukránok között: fél nap alatt 10649 tweet érkezett a témában, ezek közül 22 volt erősen botgyanús, 154 pedig nagyon valószínűleg bot. Ezzel a bottevékenység a diskurzus 1,6 százalékáért felelt.

Krekó Péter elmondta: Magyarországon a politikai diskurzus inkább a Facebookon zajlik, ezért sem érdemes annyira vizsgálni a madaras közösségi oldalt, a Twitter annyira nem népszerű. A trollok jellemzően arra a platformra mennek, ahol az adott országban a leghatékonyabb lehet a munkájuk, a botok esetében viszont az is fontos, hogy melyik oldalon lehet a legkönnyebben automatizált tartalmakat létrehozni.

Az egyébként elmondható, hogy a korábban annyit emlegetett orosz botok gazdái, a „botmesterek” erre az időszakra készültek fel az elmúlt majdnem tíz évben: az orosz-ukrán háborúban már kipróbáltan kamatoztathatják a tudásukat, erre pedig Putyinnak szüksége is van, hiszen sem a közvélemény, sem a háború nem alakul úgy, ahogyan eredetileg szerette volna.

Az Adelaide-i Egyetem kutatói arra voltak kíváncsiak, hogy az általuk elemzett több mint 5 millió, az orosz–ukrán háborúval kapcsolatos tweetből mennyi lehet a valódi személy által írt bejegyzés, és mennyi bot munkája. 2022. február 23., vagyis a háború kitörése előtti nap és 2022. március 8. között elemezték az #(I)StandWithPutin, #(I)StandWithRussia, #(I)SupportRussia, #(I)StandWithUkraine, #(I)StandWithZelenskyy and #(I)SupportUkraine hashtageket, és azt találták, hogy a tweetek 60-80 százaléka automatizált felhasználóktól származott. A kutatók úgy vélik, hogy ez fokozta a szorongást az online diskurzusokban, és akár még beleszólhatott abba is, hogy az emberek meneküljenek, vagy Ukrajnában maradjanak. Növekedést figyeltek meg az olyan szavak esetében is, mint a „szégyen”, „terrorista”, „fenyegetés” és „pánik”. Az oroszbarát „emberi” beszámolók gyakorolták a legnagyobb hatást a háborúról szóló vitákra – különösen az Ukrajna-pártiak esetében.

„A múltban a háborúkat elsősorban fizikai síkon vívták, a hadsereg, a légierő és a haditengerészet voltak a harc elsődleges formái. A közösségi média azonban új környezetet teremtett, ahol a közvélemény igen nagy léptékben manipulálható” – írta a sajtóközleményben Joshua Watt, a kutatás egyik fő szerzője.

Az Európai Digitális Médiamegfigyelő (EDMO) azt vizsgálta, hogy tavaly március 15. és április 15. között milyen Twitter-felhasználók osztották tovább az orosz nagykövetség posztjait Svájcban és Nagy-Britanniában. Korábban tényellenőrzések átfésülésével azt találták, hogy 2022 márciusában komoly diszinformáció-cunami érte el Európát: a vizsgált álhírek 59 százaléka volt Ukrajnával kapcsolatos. A koronavírussal kapcsolatos diszinformáció szinte teljesen eltűnt (a 20 fact-checking szervezet írásaiban mindössze 9 százalék foglalkozott ezzel), a legfontosabb álhírek pedig az ukrajnai biolaborokkal, a lebombázott mariupoli szülészettel, ukrán színészkatonákkal és azzal foglalkoztak, hogy a CNN álhíreket terjeszt a háborúról.

Az EDMO is a Botometert használta arra, hogy megvizsgálja, az adott időintervallumban milyen bottevékenység volt valószínűsíthető. A kutatók azt találták, hogy a tweetelők 9 százaléka szinte biztosan, 21 százaléka valószínűleg bot, és csak 29 százalékuk biztosan emberi felhasználó. A kutatók megjegyzik: 2022. március 4-én a Twitter letiltott nagyjából 100 olyan felhasználói fiókot, amelyek újraélesztették az #IStandWithPutin hashtaget, ez azonban a szakértők szerint nem fedi le az európai bothálózat szignifikáns részét. Az EDMO felmérése azt mutatta ki, hogy a vizsgált profilok 73 százaléka az orosz invázió kezdete után írta az első tweetjét.

Az oroszoknak azonban, úgy tűnik, nem elsősorban a Nyugatot kell meggyőzniük: az információs háborúban sokkal nagyobb szükségük lehet a hazai morál fenntartására, ezért a propaganda, így ezzel a bottevékenység jelentős része is inkább az országon belülre, mint kívülre koncentrál. Brit kutatók a Re:Russia weboldalon publikálták az azzal kapcsolatos eredményeiket, hogy a népszerű orosz közösségimédia-oldalakon milyen tartalmak jelennek meg az oroszoknak szánt narratívákban. Oroszország változatos közösségi médiával rendelkezik, annak ellenére is, hogy 2022 tavaszán betiltotta a nyugati platformokat. A VKontakte, az Odnoklassniki és a Telegram erre válaszul növelte közönségarányát, és a domináns közösségimédia-platformokká váltak. A kutatók a Telegramot, a VK-t és az OK-t vizsgálták, és azt találták, hogy az OK-on kifejezetten gyakori a dehumanizáló nyelvezet használata, ami botok és fizetett influenszerek tevékenységére utalhat. A Telegram viszonylag szabad tér maradt, mentes a hivatalos retorikától, de a VK-felhasználók enyhe hajlamot mutatnak a háborúról szóló hivatalos narratívák újratermelésére. A kutatók rávilágítottak: ez azt jelenti, hogy a botok és a trollok főleg a leginkább háborúpárti platformot, az Odnoklassnikit támadják, és kevésbé a VK-t vagy a Telegramot. Ez is erősíti, hogy új emberek meggyőzése helyett a propaganda sokkal hatékonyabban tudja megerősíteni a meglévő támogatók meggyőződéseit. Olyan érvekkel látja el őket, amelyek segítségével minimalizálhatják kétségeiket és elháríthatják az ellenfél támadásait. A kutatás eredményei azért is fontosak, mert ugyan az oroszok 55 százaléka a Telegramot használja rendszeresen, 42 százalékuk az Odnoklassniki, 65 százalékuk pedig a VKontakte rendszeres felhasználója is.

A Political Capitalnak van orosz trollokra vonatkozó, a magyarországi helyzetet vizsgáló kutatása. Azt találták, hogy szó szerint megegyező kommentek bukkannak fel a legkülönbözőbb Facebook-posztok sokasága alatt, így olyan felhasználókhoz is eljut a Kreml dezinformációja, akiknek soha nem jutna eszébe a háborúról bármit is elolvasni. Az oroszbarát trollok folyamatosan ugyanazt a három-négy narratívát terjesztették a háború igazolásához, amelyek elsősorban február 24. és 28. között (a háború első napjaiban) terjedtek a legintenzívebben. A Magyarországon terjedő narratívák többségéről megállapították, hogy nem itthonról eredeztethetők. A két legelterjedtebb narratíva („Ukrajna nem létezik”, „ukrán színtársulat”) külföldi befolyásolási kampányokhoz kapcsolódott, illetve az egyik narratíva eredete egy oroszbarát ukrán oligarcha egyik szervezetéhez köthető. A magyar médiatérre leginkább jellemző, a „genocídiumról” szóló narratíva ezen felül egyértelműen egy oroszországi dezinformációs kampányt adoptált a magyar médiatérre. A magyarországi inautentikus üzenetek terjesztésében pedig egyaránt szerepet játszanak mind oroszbarát oldalak, személyek, mind hamis vagy feltört profilokból álló trollok.

Bár, ahogy korábban is említettük, több kutatás azt találta, hogy a botaktivitás annyira nem hatékony befolyásoló tényező egy-egy adott témában, azért azt fontos megjegyezni, hogy nem is ártalmatlan: a trollok és a botok is egy rendszer részei, és hozzájárulnak ahhoz, hogy a közösségi médiát használók összezavarodjanak. „Érdemes őket egy eszközrendszer egy elemeként azonosítani” – mondta Krekó Péter. „Nyilvánvalóan nem szabad eltúlozni a hatásukat. A trollok és a botok sem tudnának Magyarországon sem tömegeket meggyőzni, ha Orbán Viktor, az Origo és a köztévé nem ugyanezeket a narratívákat hangoztatná, nem ugyanezek az üzenetek lennének az óriásplakátokon is. Az emberek azt hiszik, hogy ezek az álprofilok valódi emberekhez tartoznak, és ezzel azt a percepciót alakítják ki, hogy a véleményük mögött aktív tömegtámogatottság van. Ha te azt gondolod, hogy a Facebookon mindenki oroszbarát, akkor kevésbé mersz majd ellentmondani, ha neked nincs erős véleményed a témában. Ha azt hiszed, hogy egy adott vélemény mögött ott a többség, akkor lehet, hogy az rád is hat, ha nincs erős álláspontod. Ezeknek a torzult társadalmi látásviszonyok kialakításában van szerepük.” A szakértő szerint nincs olyan dezinformációs kampány, ami csak trollokat vagy botokat használt volna – ezek a rendszer egy igencsak fontos részei, de sok más taktika támogatja őket. Sőt, az úgynevezett információs zaj kialakításában is nagy szerepük van – ha ez túl intenzív, akkor a közösségimédia-felhasználók összezavarodnak, nem tudnak kiigazodni abban, hogy mi a valós és mi az álhír, ez is a trollok és botok malmára hajtja a vizet.

A közösségi oldalak felelőssége nagy, de a botok ellen küzdeni kihívás

A szervezett dezinformáció egyértelműen egyre komolyabb problémává növi ki magát az online térben, mind a trollok, mind a botok tekintetében, mégis nagyon nehéz küzdeni ellene. A közösségi oldalaknak csak az az érdekük, hogy a hálózatot elárasztó káros botokat szűrjék ki, de ez nagyjából lehetetlen a hasznos botok kitiltása nélkül – bár néhány típusú bot jól szűrhető automatikusan, a leghatékonyabb megoldás jelenleg mégis az, ha a platformok manuálisan próbálják meg ellehetetleníteni a botprofilokat. A Facebook a Statista adatai szerint 2022 negyedik negyedévében 1,3 milliárd álprofilt törölt, a legtöbbet azonban 2019 első negyedévében tisztogatott, amikor 2,2 milliárd hamis felhasználótól szabadult meg. A Meta hamis fiókoknak tekinti azokat, amelyeket rosszindulatú szándékkal vagy egy vállalkozás, szervezet vagy nem emberi entitás képviseletére megtévesztő módon hoztak létre – nem minden álprofil bot tehát, ez a statisztika még nem jelenti azt, hogy mind az 1,3 milliárd hamis felhasználó távolról irányított automatizált profil volt.

A Twitter azt állítja, hogy naponta egymillió spam felhasználói fiókot távolít el, a botok működtetése pedig kicsit nehezebbé válik majd, ha Elon Musk tényleg fizetőssé teszi a hozzáférést a felület API-ához. Ezzel azonban nemcsak a káros botok létrehozását fogja majd vissza, hanem a hasznosakét is, biztosan lesznek ugyanis olyan fejlesztők, akik csak hobbiból hoztak létre ilyen automatizált felhasználói fiókokat, és nem szeretnének érte fizetni. A nagy botfarmok számára viszont valószínűleg nem lesz probléma fizetni az API-hozzáférésért.

„A rosszindulatú botok jelenléte olyan toxikus környezetet teremt a közösségi oldalakon, ahol a felhasználó folyamatosan bizonytalan, hogy az, akivel kommunikál, valódi felhasználó-e, vagy sem. Nem találja meg azokat a tartalmakat, amelyek őt érdeklik, mert a botok elárasztják értelmetlen üzenetekkel a falat. Ez jelentősen ronthatja a felhasználói élményt – mondta Kollányi Bence. – A platformok szerintem annyit tehetnek a káros botok ellen, hogy egy olyan környezetet hoznak létre, amiben a botok egészségesen tudnak együttműködni a valódi felhasználókkal. Ehhez viszont transzparencia kell. Valamilyen módon egyértelműen jelölhetővé kell tenni a botokat, és adott esetben el kell várni a fejlesztőtől, hogy ezt a jelölést meg is tegye.” A kutató kiemelte: a káros botokat fejlesztők nyilván nem fogják megjelölni a saját profiljaikat károsként, de már azzal is előrébb vagyunk, ha a jó botokat megkülönböztetik a valódi felhasználóktól.

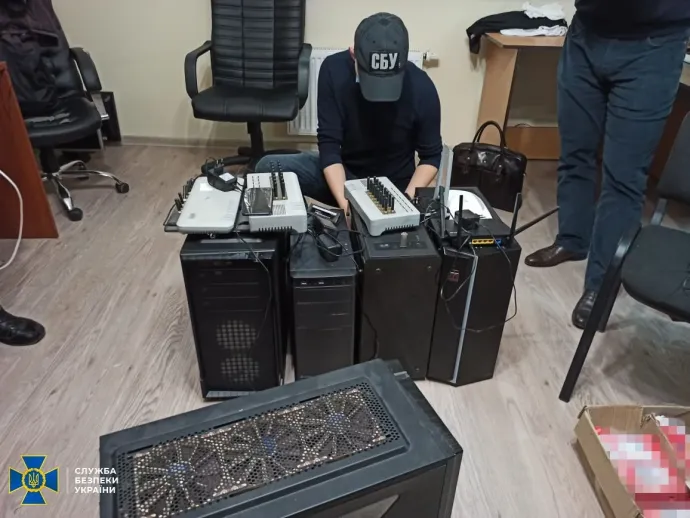

Az országok kibervédelemért felelős hivatalai is monitorozzák a bottevékenységet, erről főleg az orosz–ukrán háború kapcsán hallani mostanában. Bár valószínűleg Ukrajna is ugyanúgy használja a botfarmokat propaganda terjesztésére, mint Oroszország, a háború természetéből adódóan főleg arról érkeznek hírek, hogy az orosz dezinformációs központokat mennyire sikerül lekapcsolni. 2022 nyarán például az ukrán kiberrendőrség egymillió, álhíreket terjesztő botot szűrt ki, amelyek az országon belül próbálták meg a hivatalos ukrán állami forrásokból származó információkat hitelteleníteni, az ország társadalmi és politikai helyzetét destabilizálni. Mivel a botok narratívái megegyeztek az orosz propagandával, az ukránok feltételezik, hogy az oroszok állhatnak a hálózat mögött. 2022 novemberében az ukrán hatóságok rajta is ütöttek egy Kijev külvárosában működő botfarmon, az innen irányított botok állítólag az orosz agressziót próbálták meg realizálni az ukrán közönség számára.

Miközben kutatók számos modellt építettek már a közösségi médiában fellelhető botfiókok felderítésére, a támadók fejlesztik a módszereiket, hogy elkerüljék a kutatók modelljeit. Ez az örökké tartó macska-egér játék az oka annak, hogy ezek a modellek folyamatos fejlesztést és újításokat igényelnek.

Átlagemberként még ennél is egyre nehezebb feladat kiszűrni a botokat. „Korábban még mondhattuk, hogy figyeljen az ember az egyszerű szabályok alapján létrehozott, egymáshoz nagyon hasonló posztra, az emberek számára értelmetlen szövegekre, de ahogyan a mesterséges intelligencia fejlődik, úgy lehet egyre intelligensebb, az emberi kommunikációt egyre jobban mímelő botokat létrehozni, és kiküszöbölni ezeket az árulkodó jeleket – mondta Kollányi Bence. – Ezzel sokkal nehezebbé válik a felhasználók számára az, hogy ki tudják szűrni a nem valódi profilokat.” Valószínűleg a rendszerszintű megoldás lehet a célravezető – de hogy pontosan ezt hogyan kellene levezényelni, azt, úgy tűnik, egyetlen közösségi oldal sem tudja még.

A Telex weboldalára azóta nem érkezett ilyen támadás, de ezzel a megoldással azok a valódi olvasók sem jutnak hozzá a Telex Facebook-oldalához, akik ebben vagy a többi, jellemzően bottámadás forrásaként azonosított országban élnek. Nem derült ki az sem, hogy ki küldte a vietnámi botokat, vagy hogy milyen céljuk lehetett pontosan.

Ehhez a cikkhez fizetett együttműködés keretében az Alrite beszédfelismerő (speech-to-text) megoldást használtuk.